Les événements peuvent arriver par hasard ou par nécessité mais ils ne peuvent arriver par contingence, car le contingent recouvre tout ce qui peut arriver. Pour qu’il y ait une science du contingent, il faudrait que tout arrive par nécessité car pour Aristote, il n’y a de science que du nécessaire.

les énoncés vrais sur le passé sont-ils nécessaires ? on pourrait diviser nécessité = passé/hasard = présent/futur = contingence. Pour les Mégariques, on a 3 thèses :

(1) toute proposition vraie concernant le passé est nécessaire (on voit ici un écho de Leibniz qui pense que l’histoire est le substitut humain de la connaissance des vérités contingentes puisqu’elle nous montre les meilleurs existants contingents possibles, mais chez Leibniz, possible et nécessaire ne s’excluent pas)

(2) l’impossible ne suit pas logiquement du possible

(3) est possible ce qui n’est pas vrai dans le futur, càd nécessaire, ni maintenant

A (3) Aristote oppose une restriction de la nécessité à des énoncés tautologiques comme p ou non-p. On explique justement que « vrai dans le futur » ne veut rien dire car le futur est invérifiable dans le présent (à moins de voyager dans le temps). Soit le possible est impossible (inactualisable), soit le possible est le nécessaire. Pour Aristote, la valeur de vérité se restreint au passé et au présent, c’est pourquoi il n’y a pas de science du contingent, qui est le futur, ni de science du hasard. Ce débat illustre le rôle du temps dans la partition entre les 3 concepts du sujets.

(4) Il est possible que p => il est possible que non-p

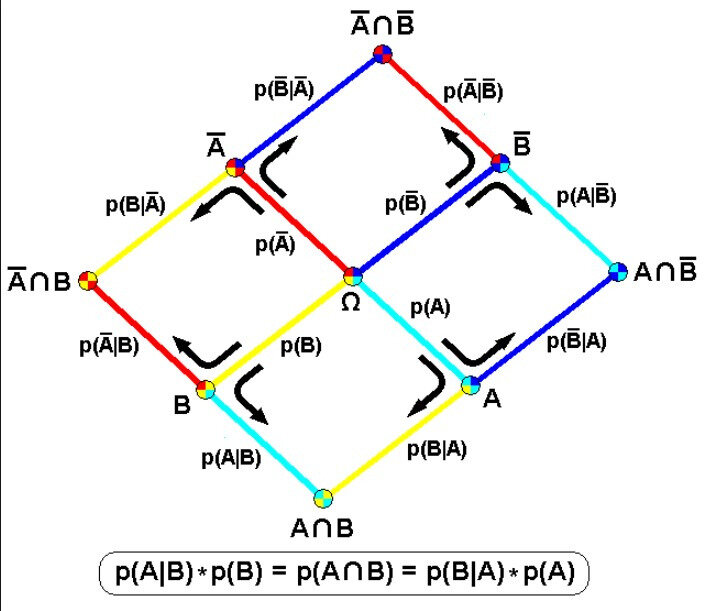

Partant de (3), on déduit de (4) que, si p en t, alors p n’est pas possible en t-x et non-p est seul possible en t-x. Mieux, puisque p n’est pas possible maintenant que sa nécessité a été établie rétrospectivement en t, p n’est pas possible non plus en t+x. Mais pour les Mégariques ça reste cohérent puisqu’est possible ce qui n’est pas vrai dans le futur. Donc si p en t, p n’est pas possible en t-x et non-p est possible en t-x. Pourtant, on a supposé (4), parce que si on donne à « possible » le sens des Mégariques dans (4), on viole le principe de non-contradiction : p & non-p ne peuvent pas ne pas être vrais dans le futur (ou du moins si par « dans le futur » on entend le même instant t pour p & non-p et non t1 et t2 t. q. t1 < t2). Donc à (4) les Mégariques doivent substituer

(4bis) Il est possible en t-x que p => il est nécessaire en t-x que non-p

Pour (2) on peut y voir un argument contre le libre-arbitre ; en t-x, (p ou non-p) sont possibles ; cela veut dire : il est possible que p ou non-p soit faux en t, ce qui veut dire : il est faux en t que p ou non-p soit faux en t, ce qui est vrai, car il est vrai que p ou non-p est vrai en t <=> il est faux qu’il est faux que p ou non-p en t. Donc la conception qu’ont les Mégariques du « possible » se tient (mieux que celle d’Aristote).

Mais en t, si p, alors non-p devient impossible en t parce qu’il est impossible que (p & non-p en t) ; donc d’un possible (non-p en t-x) résulterait un impossible (non-p en t), ce qui contredit (2) mais comme non-p n’était pas vrai dans le futur t en t-x parce que p en t, alors non-p est possible. Donc de (non-non-p en t-x & non-non-p en t) & (non-p en t-x & p en t) il suit que c’est p qui est impossible et que c’est non-p qui est possible alors que non-p n’a pas lieu et que p a lieu. Ce qui est possible n’arrivera jamais, ce qui est impossible arrivera nécessairement.

On voit qu’au possible ne s’oppose pas l’impossible (car si p était impossible, il n’y aurait pas p en t) mais le nécessaire (appelons cela principe alpha). En revanche, le possible et le contingent sont identiques, en tout cas dans un cadre de pensée aristotélicien. Aristote rejette cette conception temporelle de la vérité comme une « illusion rétrospective ». On peut notamment faire valoir que rien ne permet d’identifier non-p en t-x à non-p en t (de même pour p). On va démontrer cela.

Quant à (1) une proposition nécessaire peut devenir fausse dans le temps (on rompt avec Aristote). Par exemple pour Aristote, si je n’ai pas encore lancé le dé, il est nécessaire que je joue ou que je ne joue pas, et donc il ne pourra jamais être/devenir nécessaire que je joue. Pourtant si je joue un 6 il est nécessaire que j’aie joué. Donc il est nécessaire que j’aie joué. Quand est-il devenu nécessaire que je joue ? On notera que cette question relie le sujet au problème du libre-arbitre, qui se formule plus généralement en « x n’a pas le choix à propos de p », qui peut formaliser « il est nécessaire que p » ou « p est dû au hasard » selon les cas. Donc :

(1a) il n’est pas nécessaire que x joue aux dés en t

(2a) il est possible que x joue aux dés en t (en vertu du principe alpha)

(3a) (1a) <=> (2a)

(4a) il est nécessaire que si x joue un 6 en t+1, x joue aux dés en t+1([1])

(5a) il est nécessaire que x joue aux dés en t+1

En vertu de (3) est possible ce qui n’est pas vrai dans le futur, pourtant en vertu de la logique modale, s’il est nécessaire que x joue aux dés en t+1 alors il est vrai que x joue aux dés en t+1, mais cela ne prouve pas que « x joue aux dés en t » est vrai dans le futur car dans le futur, il est vrai que « x joue aux dés en t+1 » et ces deux énoncés ne sont pas équivalents. La notion de « vrai dans le futur » n’a aucun sens (on dit toujours en t qu’il est vrai que x est vrai en t-x mais jamais en t-x qu’il est vrai en t).

([1]) On distingue « lancer les dés » de « jouer aux dés » car « jouer aux dés » est défini par : lancer les dés & faire 1, 2… ou 12. Si x lance les dés par la fenêtre, il ne joue pas aux dés. Donc « x joue aux dés » et « x joue un 6 » sont bien simultanés.

Je reprends l'argument du jeu de dés à l'Essai sur le libre arbitre de Peter van Inwagen.

([1]) On distingue « lancer les dés » de « jouer aux dés » car « jouer aux dés » est défini par : lancer les dés & faire 1, 2… ou 12. Si x lance les dés par la fenêtre, il ne joue pas aux dés. Donc « x joue aux dés » et « x joue un 6 » sont bien simultanés.